英语原文共 5 页,剩余内容已隐藏,支付完成后下载完整资料

基于深度自动编码器对电机定子匝间短路连续状态的故障诊断方法

摘 要:电机是工业中最常用的设备之一。要保证电机的可靠性,必须能及时识别电机发生的故障类型,以保证电机的正常运行,减少损失。本文提出了一种基于深度自动编码器和soft-max分类器的电机定子匝间短路和不平衡电源故障诊断系统。分析了神经网络参数对训练过程和参数选择的影响。所提出的故障诊断系统可以将电机状态映射到一个平面的不同区域对应的二维向量上,以识别不同的故障类型。最后,通过电机实验验证该系统的有效性。结论表明,当使用离散状态的电机数据进行实验时,该系统能够在连续状态下以99.5%以上的准确度识别电机的故障类型,表明了该系统的可扩展性以及广阔的应用前景。

关键词:故障诊断;自动编码器;soft-max分类器;参数选择;连续状态

1.简介

电机是现代工业、生产、生活中最常用的驱动设备,其使用范围非常广泛。如果发生了电机故障,便可能会产生严重的后果,造成人身伤害和财产损失。电机的状态监测和故障诊断可以及时检测故障并进行修复来保证电机的可靠性,具有较高的理论和应用价值。

目前,电机故障诊断的常用方法大多是测量和分析电机的运行状态参数,如电压、电流、温度、振动等,基于此以判断电机的运行状态和故障类型[1]。最广泛的使用方法是电机电流特征分析(MCSA),包括离散小波变换、连续小波变换、Hilbert-Huang变换和傅里叶变换[2-3]。根据现有的电机测量参数及其故障类型,贝叶斯网络、模糊推理[4]、支持向量机(SVM)等方法也被应用到电机故障诊断中,取得了良好的效果。

随着计算机和硬件计算能力的提高,基于多传感器融合和机器学习的故障诊断方法得到了广泛的关注和应用。基于人工神经网络 ( ANN)和深度学习的智能电机故障诊断被提出[5],其输入特征向量仍需人工确定。但传感器的不同布置使得特征选择更加困难,系统的不确定性也更大[6]。HINTON提出了自动编码器,即一个训练网络[7],用于学习高维数据的低维特征表达,该网络已成功应用于滚动轴承的故障诊断[9-10],

本文针对上述缺陷,提出了一种基于深度AE网络和soft-max分类器的电机定子匝间短路和不平衡电源故障诊断系统。详细介绍了系统参数的确定过程。随后,通过故障电机实验验证了该方案的有效性。本文提出的电机故障诊断系统通过在不同转速和负载下的离线前训练,获得一组神经网络参数,可以实现全速和全负载范围内故障类型的在线识别。

本文的其余部分组织如下。首先详细介绍了深度AE网络和soft-max分类器的原理。其次在实验室环境下,将该方法应用于电机,并进行实验验证,接着给出神经网络参数的选择方法。最后得出结论。

2. 深度自动编码器和soft-max分类器原理

2.1.深度自动编码器

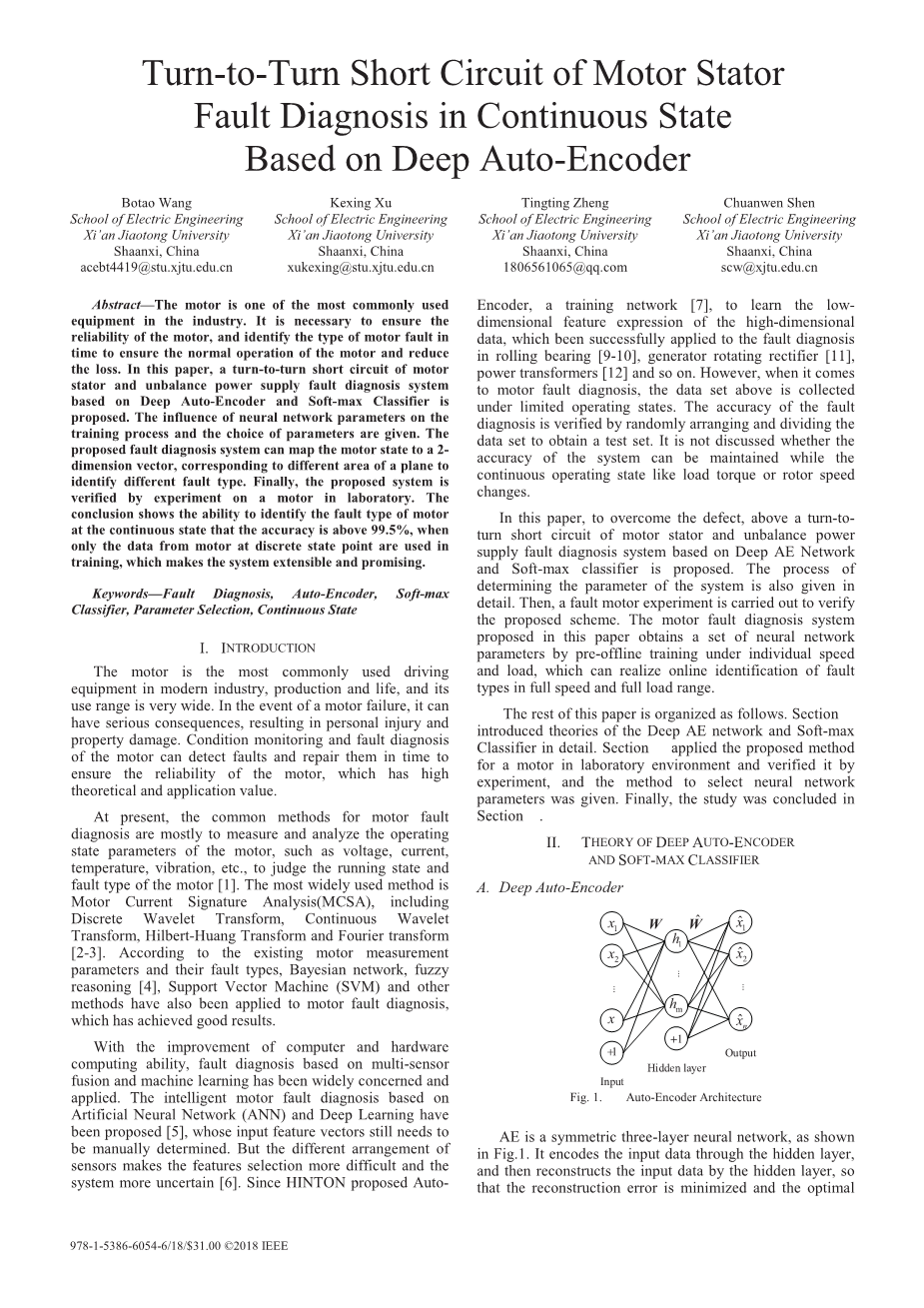

图1. 自动编码器体系结构

AE是一个对称的三层神经网络,如图1所示。通过隐层对输入数据进行编码,再通过隐层对输入数据进行重构,使重构误差最小、最优。得到数据隐藏层表达式。假设每个训练集向量x = [x1 , x2 , x3 , , xn ]T, AE的输出向量 = [1 , 2 , 3 , hellip;, n ]T 。解码后的应该尽可能接近输入x,可以通过重构误差函数来表征:

JAE = -x2 (2 2) (1)

其中JAE为变换损失,.2 为一个向量或一个矩阵的二范数,和 为权值矩阵。

根据AE的体系结构,神经网络的变换公式可以表示为:

=sigma;(x b) (2)

=sigma;(h ) (3)

其中=[1, 2 , , m ]T(m lt; n) 是隐藏层,表示特征向量的向量b和为无维偏差,(x)为激活函数,旨在构建神经元网络的非线性。一般,非线性变换函数可以选择Sigmoid函数、tanh函数、ReLu函数等[13]。本文选择了Sigmoid函数。

当损失函数最小化时,可通过梯度下降算法(GDA)逐步求解,以获得最小损失函数JAE和模型参数值W和b。训练结束后,隐层向量可以作为输入特征。

然而,传统的声发射结构中只有三层神经网络,过于简单。这可能会导致相同的映射,从而使特征向量无效[14]。增加层数,将声发射转化为深度网络,可以增加非线性。从而提高了声发射特征向量的可靠性。深度AE的架构如图2所示。

图2. 五层深度自动编码器的体系结构

随着神经网络的变化,上述计算公式也随之变化:

1=sigma;((1)x b(1)) (4)

m =sigma;((2)h1 b(2)) (5)

1=sigma;((3)hm b(3)) (6) =sigma;((4) b(4)) (7)

其中1,m,1, 是每层的向量,其维数分别为 n, m, k, m, n, (n gt; m gt; k ), hm是表示特征向量的中间层,W(i)是1,2,3,4层之后的权重矩阵。损失函数为:

JAE = -x2 (i) (8)

其中,为权重惩罚系数。训练后,可以取最中间神经元的输出向量作为特征向量。

2.2 soft-max分类器

图3. 软最大分类器的结构

soft-max分类器是logistic回归模型在多分类问题中的推广[15]。在soft-max函数之后,AE的特征向量可以映射到概率域,概率域介于0和1之间,并求和为1。soft-max分类器建立了特征向量与不同标签概率之间的联系。soft-max分类器的结构如图3所示,其中A表示AE的编码过程,B表示soft-max分类器的结构。最右侧的神经元层是AE的中间层和Soft max分类器的输入。转换分为两个步骤。第一步是将特征向量的维数压缩为与标记相同的数字。它本质上是一个两层反向传播(BP)神经网络,可以进行计算为:

(9)

其中hm = [h1 , h2 , hk ] 是维数为m的特征向量,Ws 和bs 是权重矩阵和偏差向量,v = [v1 , v2 , , vn ]T 是证据值。

第二步是将证据值映射到概率域:

,=1,2,3hellip;n (10)

其中,n是类别的数量,p = [p1 , p2 , , pn ]T是对每个概率的最终预测。

在训练过程中,目标是最小化预测概率和与概率共享相同维度的相应标签的交叉熵。如果标签属于类别i(i=1,2,3,4),则标签向量中的第i个元素为1,其余元素为0。Soft-max 训练是监督学习,目的是最小化预测概率与标签之间的交叉熵CE:

(11)

其中[ 1 , 2, n]是样本的标签向量。然而,当数据量过大时,训练将花费很多时间来收敛。因此,通常的方法是将原始数据集分成几个小批量,分别进行训练。虽然批量训练结果的CE略大于所有数据集训练,但系统的预测精度较高,训练时间也会大大缩短

(12)

其中B = {p(1) , p(2) , , p(q) }是大小为q的批次p,l = [l1 , l2 , , ln ]T是样本的标签向量。当训练结束时,预测概率足够接近标签向量。然后对特征向量及其类别进行对应。学习过程结束。

3.实验研究

3.1数据的准备和处理

通过实验验证,本文采用YVF2-712-4型异步电动机。电机参数详见表一。

表一 异步电动机的参数表

|

项目 |

符号 |

符号 |

|

额定电压/V |

U r |

380 |

|

额定频率/Hz |

r f |

50 |

|

额定负荷/Nm |

T r |

2.36 |

|

定子绕组连接 |

- |

Delta |

|

定子电阻/Omega; |

R s |

6.571 |

|

极对数 |

p |

2 |

如图4所示。电流和电压由霍尔传感器测量。模拟信号由AD7606转换芯片转换为数字信号并由德克萨斯仪器公司的DSP F28335存储。

图4。实验平台:(a)电机实验系统;(b)日期收

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[591191],资料为PDF文档或Word文档,PDF文档可免费转换为Word

课题毕业论文、外文翻译、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。