英语原文共 12 页,剩余内容已隐藏,支付完成后下载完整资料

学习用于音频分类的可分离时频滤波器库

蒲杰1, Yannis Panagakis2, and Maja Pantic 1,3

英国伦敦帝国学院计算机系 希腊雅典大学信息学和电信系 3Facebook人工智能研究部,英国伦敦

摘 要

最先进的音频分类系统通常将深度神经网络应用于手工制作的特征(例如,基于频谱的表示),而不是直接从原始音频中学习特征。此外,这些音频网络有数以百万计的未知参数需要学习,这导致对计算资源和训练数据的巨大需求。在本文中,我们旨在直接从原始音频中学习音频表征,同时通过采用轻量级的架构来减轻其训练负担。特别是,我们建议学习可分离的滤波器,只用几个变量,即中心频率和带宽进行参数化,方便训练并提供所学表征的可解释性。我们将所提出的方法应用于两种应用,即1)说话人识别和2)声学事件识别,从而证明了该方法的通用性。实验结果表明其在这些应用中的有效性,特别是在有少量训练数据的情况下。

关键词:深度学习 音频分类 可分离 滤波器库

- 引言

机器学习算法的成功在很大程度上取决于对数据表示的选择(即特征)。事实上,合适的表征能够为手头的任务捕捉到数据的基本解释因素。因此,学习合适的特征表示已经得到了机器学习、计算机视觉和信号处理界越来越多的关注。在最近的深度学习浪潮中,深度神经网络(DNNs)已经证明了与原始数据的分类器共同学习强大表征的卓越能力。特别是,基于卷积的神经网络(CNN)在广泛的应用中表现出最先进的性能,如图像分类[1]、物体检测[2]、语音识别[3]、声音事件定位[4],仅举几例。

在音频分析任务中,以前的工作[3][4]经常在音频的二维表示上应用标准的CNN。

例如,频谱图。尽管这种方法很受欢迎,但直接将标准CNN应用于音频频谱图表现出几个缺点。首先,CNN的二维过滤器(核)等同于处理其水平(时间)和垂直(频率)轴。这是为图像像素量身定做的,但不是为音频频谱量身定做的,因为频谱的横轴和纵轴代表不同的量,即时间和频率。其次,标准的CNN需要在训练中学习每个滤波器的所有元素,因此需要大量的训练数据。当只有少量的数据可用时,由CNN学习的滤波器[5]往往采取不协调的形状,导致难以解释的特征表示。

鉴于上述挑战,我们需要设计轻量级(即需要学习的参数较少)的神经网络,为音频信号量身定做,并且在少量的训练数据下也能正常工作。在设计轻量级网络结构的方向上的第一次尝试是为计算机视觉应用提出的。例如,许多研究人员考虑将大型卷积核分解成一系列较小的卷积核[6] [7] [8],从而大大减少CNN的参数数量。这些类型的结构被证明在获得的性能和它们所产生的计算成本之间提供了一个良好的平衡。在音频分析任务中,我们可以在减少参数方面更进一步。最近的一个趋势是从原始音频中学习参数化的滤波器库[9],其中只需要学习表征音频滤波器的高级参数。具体来说,Ravanelli和Bengio[10]提出从原始音频中学习sinc滤波器,只需要学习两个高级参数,即低和高的截止频率。[11]提出为大规模的鸟类检测任务学习小波变换的花键滤波器库。Zhang等人[12]提出从音频谱图中学习长期滤波器,并应用于声学场景分类和音源分离。

与上述方法不同的是,我们提出了一种新的方法来学习可分离的时频滤波器库,它直接将原始音频作为输入,并具有一个轻量级的网络结构。特别是,我们使用分离式

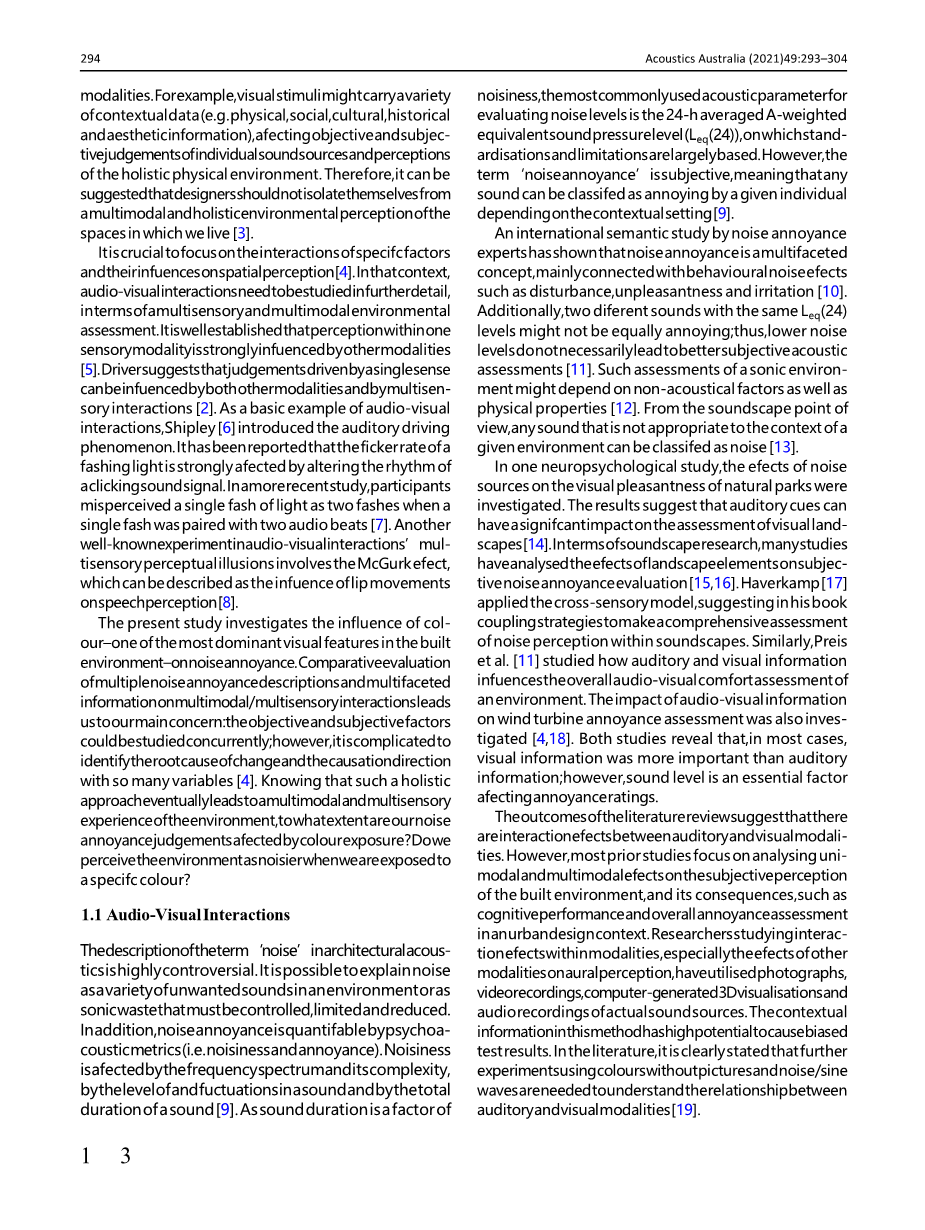

图1.拟议的可分离时频滤波器库的概述。音频原始波形被直接送入滤波器库。第一层应用一维Morlet滤波器,将声音信号转换为时频表示。第二层使用二维可分离莫雷特滤波器库来进行频谱-时间分析。然后,从滤波器库得到的表示被送入标准的CNN或DNN层,以完成监督学习任务。

莫雷特滤波器将分别学习音频时频分布的频率和时间信息。这里的每个滤波器只用两个可学习的参数:中心频率和带宽。这大大方便了它的训练过程,也提高了所学表征的可解释性。

- 建议的方法学

所提出的方法受到联合时频散射[13]的启发,由于其可分离的二维小波分解,在时间和对数频率的音频表征中提取了对变形的不变性,在音频分类上表现良好。然而,联合时频散射只使用固定和预定的小波滤波器。鉴于音频分析任务的多样性和差异性,使用预定义的过滤器可能不会导致所有任务的最佳音频表示。实际上,有证据表明,音频滤波器的选择性调谐对于听觉系统中自然声音的辨别非常重要[14]。换句话说,最好是使用定制的滤波器库,以适应手头的具体数据和应用。因此,我们提出了可分离的时间-频率滤波器库,它可以从数据中自动学习最佳的小波滤波器。

与联合时频散射相类似,提议的模型包含两层。第一层通过一个一维小波滤波器组将声学信号转换为时频表示。在第二层,我们将一组二维可分离的Morlet小波滤波器应用于第一层得到的时频表示。所有这些滤波器都有两个可学习的参数:中心频率和带宽。图1描述了拟议模型的概况。

数学背景和符号。如[13],我们将一维莫里特小波表示为^(t),二维时频小波表示为^(t, log A)。一阶张量(即矢量)表示为w,二阶张量(即矩阵)表示为W。

矩阵)为W,阶数大于3的张量为W。与W的规则卷积为X ? W

-

- 拟议的滤波器库的第一层

在数学上,我们把滤波器库的第一层表示为Wi,它由一维Morlet小波^(t)组成,每个小波作为一个一维滤波器。换句话说,Wi = [Vgt;Ai ,Vgt;A2 ,-,^Ani]。其中

和t 2 RixT,ca.-,(t)2 RixT。因此Wi 2 RN1xT。A是中心频率,ai控制带宽。与散射变换中A和ai是固定的和预先定义的不同,我们将A和ai设置为可学习的参数,并通过训练来优化它们。设X为输入的原始音频,第一层后得到的特征图Fi = X?Wi,捕捉音频信号的时频内容。

-

- 第2层拟议的滤波器库

在第二层,滤波器库表示为W2,由二维时频小波组成^(t, log A)。二维小波是两个一维Morlets小波在时间^a;a2(t)和对数频率^.-3(log A)的乘积

F..A.-2^3 (t; l0g A) = .- (t) 0 ^.-3 (l0g A) (2) 其中0表示外积。cv.- (t) 2 RixT,^^.-3 (log A) 2 RixF和^(t, log A) 2 RTxF。a, fl是中心频率,而a2, a%控制带宽。定义的^(t, log A)有两个可分离的小波^(t),^(log A),可以沿着时间和对数频率独立扩展,并分别学习音频频谱图的频率和时间信息。这对音频分类任务至关重要,因为它对时间和对数频率的变形都有内变性[13]。每个一维Morlet小波都有

两个可学参数,因此可分离的时频小波^(t, log A)将有四个可学参数,即a, ft, ^2, 03。

每个时频小波^(t, log A)作为第二层的一个二维可分离滤波器,构成滤波器库张量W2的一个正面切片。因此,W2是一个尺寸为RT xF xM的三阶张量,其中M是第二层的总时频小波的数量。让X为输入的原始音频,第二层后得到的特征图F2 = X ? W1 ? W2.

-

- 实施细节

在数值实验中,我们通过训练数据学习第一层的一维小波ftx;ai(t)和第二层的二维小波t,log A),并将它们初始化为联合时频散射的小波。由于这些滤波器的分析表达式相对于它们的参数(即A、a、ft和o)是可微的,它们可以通过梯度下降等一阶方法进行优化。因此,它们可以被用作DNN的前端特征提取器(即前两层),并通过反向传播进行学习。

音频分类任务的标准设置是从16kHz采样的波形开始,使用W=400个样本(25ms)的窗口进行STFT。同样,我们模型的第一层是作为卷积层实现的,以原始波形作为输入,宽度为W=400。音频信号的最大频率(即奈奎斯特频率)是8kHz,最小频率被假定为32Hz,因此我们在第一层需要N1=65个滤波器作为中心频率k

的扩张小波A=2Q,Q=8时k=[40,41,42,..., 104]。该层的卷积是零填充的,以产生相同的输出大小。为了确保可学习的参数是非负的,我们将在构建小波之前取其绝对值。

在我们模型的第二层,二维小波^(t, log A)是由N2=7个时间小波ft(t)和N3=6个频率小波^(logA)构建而成。通过定义a 2和p.=[0,1,2,3,4,5,6],扩张的时间小波ft(t)的中心频率a跨度为1Hz-64Hz。另一方面,通过定义ft=2和=[-3, -2, -1,0,1,2],扩张的频率小波的中心频率跨度为0.125Hz-4Hz的范围。鉴于自旋s=plusmn;1指定了振荡的方向(向上或向下),我们在^(s log A)上有2N3=12个频率小波,最终在这一层产生7*12=84个小波滤波器。

-

- 建议的滤波器库的属性

建议的可分离时频滤波器库有三个显著的特性。1) 可分离性:建议的滤波器库在第二层有可分离的滤波器^(t, log A),它们分别处理音频的两个时频表示轴。

分开。2) 轻量级结构,即少数参数:与标准CNN层相比,所有的滤波器元素都需要学习,而提议的滤波器只有两个参数(即中心频率和带宽)。这就为从最小的训练数据中得出非常有选择性的过滤器提供了可能。3)可解释性:所提出的过滤器只有高级参数,它们有明确的物理含义,因此在训练后提供可解释的表示。

- 实验

本节对所提出的滤波器库在实际应用中进行了全面的实验评估。我们进行了两组实验,总结如下。

- 发言人识别。所提模型的性能首先在说话人识别任务中得到评估,其目的是对说话人的语音进行正确分类。分类结果与其他最先进的方法进行了全面比较。带有MFCCs的DNNs,带有FBANK特征的DNNs

- 含有联合时间-频率散射的DNNs

- 含有原始波形的CNN和SincNet[10]。所提出的模型被证明比所有这些比较方法都获得了改进。

- 声学事件识别。为了评估所提出的模型对大规模时频结构的捕捉能力,我们进行了声学事件识别的实验。分类结果与基线和其他最先进的方法进行了全面比较。Delta-MFCCs [16], RG [17], LTT [18], RNH [19], Ensemble [20], SoundNet [21] 和 L3-Net [22]。

- 扬声器识别

所提出的模型首先在说话人识别任务中进行了估计,数据来自TIMIT数据集[23]。该数据集的预处理采用了SincNet[10]的方法。我们直接将原始波形输入到提议的模型中,每个语音句子被分割成200毫秒的片段(帧),有10毫秒的重叠。该网络首先通过应用softmax分类器进行帧级说话人分类,并提供一组目标说话人的后验概率。然后,通过对帧的结果进行平均,得到句子级别的分类。

对于网络结构,前两层应用了第2.3节所述的可分离的时间-频率滤波器库,在第一

层使用65个滤波器,在第二层使用84个滤波器。网络结构的其余部分与SincNet[10]保持一致。建议的滤波器库的参数使用联合时频散射进行初始化,而网络的其余部分则使用广泛使用的 'Glorot '初始化方案[24]。

表1.发言人识别任务的分类错误率(CER%)。最佳表现为黑体字。

|

模型 |

误差率(%) |

|

原始波形-CNN |

1.65 |

|

MFCC-DNN |

0.99 |

|

FBANK-DNN [15] |

0.86 剩余内容已隐藏,支付完成后下载完整资料 资料编号:[590593],资料为PDF文档或Word文档,PDF文档可免费转换为Word |