英语原文共 5 页,剩余内容已隐藏,支付完成后下载完整资料

基于颜色的实时分拣机械臂系统

贾永辉、杨国军、贾法尔.萨尼

电子计算机工程系

伊利诺伊理工学院,芝加哥,伊利诺伊州,美国

摘要:分拣是一个劳动密集的过程。用机器可以识别物体,可以自动分拣过程。在本文中,我们提出了一种基于颜色识别技术。在这个系统中,当一个新的帧通过摄像机拍摄,利用彩色图像处理技术对目标进行检测。物体在现实世界中的位置将由它在图像中的质量中心来计算。使用逆运动学算法,机器人手臂的控制输入将计算后发送给Arduino微控制器。然后,微控制器将驱动机械臂上的电机进行分类。根据物体的颜色来定位。使用提出的技术,分拣机械臂系统可以正确区分和分拣不同的物体机器视觉和3D机动性的调整参数机器人手臂。

一、引言

近年来,机器人自动化是一个过程对工业环境非常重要,因为提高质量且同时减少完成所花费的时间一个给定的任务,所有这些都需要最少的人工干预。人们一直在寻找发展智能的方法。

机械臂为他们的进一步就业提供了各种有用的已经取得巨大进展的应用在机器人领域[1]。工人通常操作机器他们可以完成某些任务。操作过程需要提供理想结果的鲁棒函数算法有效地。分拣机的主要目标是控制机械臂执行精确的采摘动作将面板中的任意颜色物体放到分配的分拣框。本文提出了一种新的物体分拣方法。自动使用单摄像机图像处理技术以及反向运动学算法[2][3]。基于颜色检测、分割和定位二维平面中的相机用于通过与机械臂控制器的串行通信,用于3D拾取以及物体的重新定位。

二、硬件系统架构

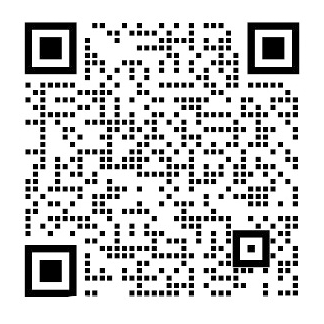

硬件系统布局包括机械臂如图1所示。

图1 分拣机械臂系统布局

图2 Phantom X Reactor机械臂(左)Dynamixels AX12A(右)

图3 底部旋转(左)和垂直伸展(右)

机器人控制器是一个ArbotiX-M微控制器如图4所示。控制器有两个串行端口,28个数字I/O,可由Arduino IDE编程软件。

图4 ArbotiX-M控制器

为了构建系统,采取了以下步骤:

- 利用摄像机输入进行物体检测和识别。

- 使用物体在图像中的位置估计物体在三维坐标中的位置。

- 用D-H矩阵求解运动学反问题。

- 为Arduino单片机开发软件。

整个系统的工作流程如下:

图5。机械臂工作流程分类

三、图像处理与目标检测

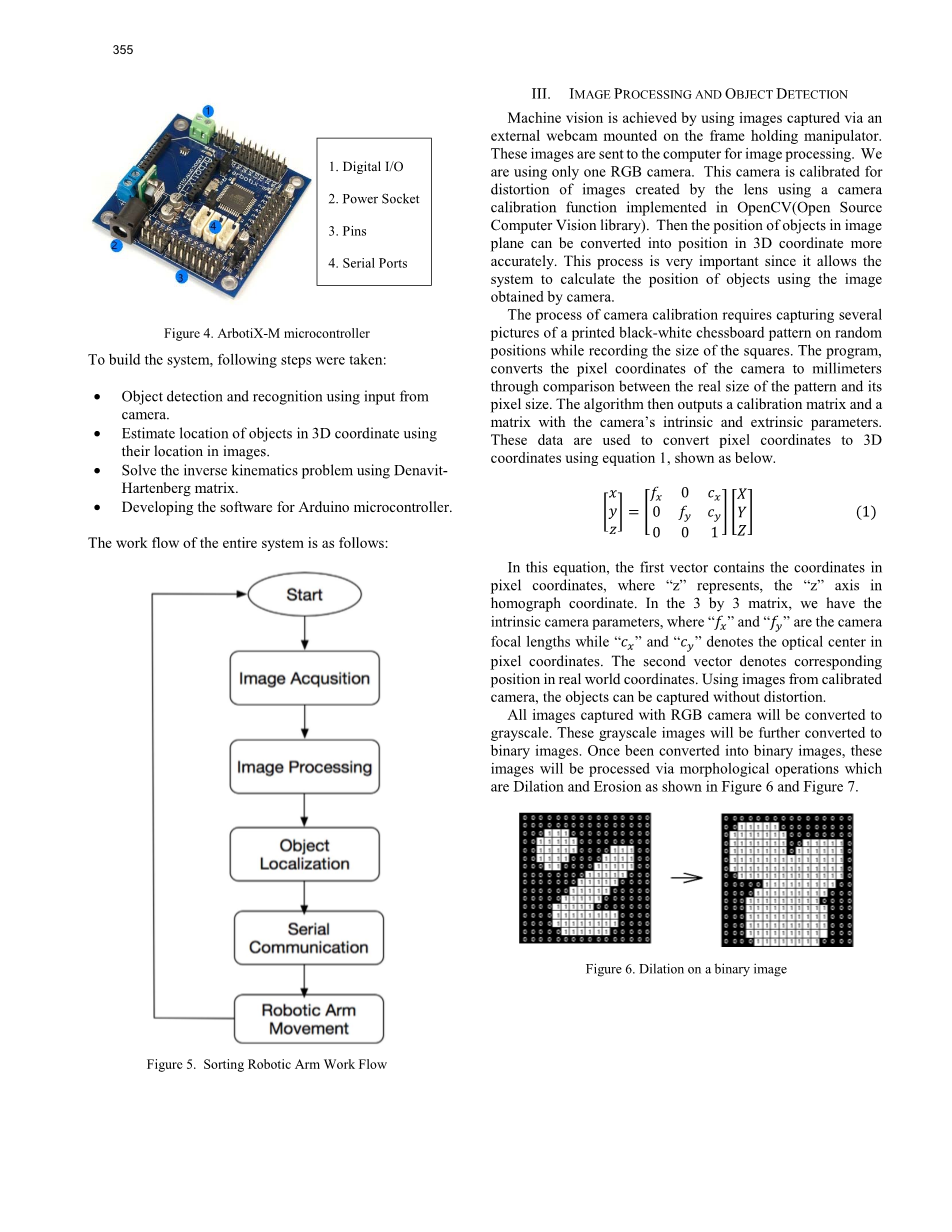

机器视觉是通过使用通过安装在帧保持操纵器上的外部网络摄像头。这些图像被发送到计算机进行图像处理。我们只使用一个RGB相机。这台相机是为使用相机的镜头产生的图像失真OpenCV(开源)中实现的校准功能计算机视觉库)。那么物体在图像中的位置平面可以在三维坐标中转换为位置更多准确地说。这个过程非常重要,因为它允许使用图像计算物体位置的系统由摄像机获取。摄像机校准过程需要捕捉随机打印的黑白棋盘图案的图片记录方块大小时的位置。程序,将相机的像素坐标转换为毫米通过对图案的实际尺寸与像素大小。然后,该算法输出校准矩阵和矩阵与相机的内在和外在参数。这些数据用于将像素坐标转换为3D使用方程式1的坐标,如下所示。

(1)

在这个方程中,第一个向量包含像素坐标,其中“Z”表示“Z”轴同形坐标。在3乘3矩阵中,我们有内置摄像头参数,其中“”和“”是摄像头焦距,“”和“”表示中的光学中心像素坐标。第二个向量表示对应的在真实世界坐标中的位置。使用校准后的图像相机,可以不失真地捕捉物体。使用RGB相机拍摄的所有图像都将转换为灰度级。这些灰度图像将进一步转换为二值图像。一旦转换成二进制图像,图像将通过形态学操作进行处理,膨胀和侵蚀如图6和图7所示。

图6 二值图像的扩张

图7 二值图像的腐蚀

扩张可以逐渐扩大前景像素(通常为白色像素)使当这些区域中的孔变为更小。侵蚀侵蚀侵蚀了前景(白色)像素,缩小物体和放大孔在这些区域内。这些操作的组合允许我们可以去除背景中最不需要的噪音,以及使物体彼此隔离。这些的结果形态操作如图8所示。

图8 形态分析结果(a)原始图像;(b)形态分析后

下一步是评估物体的循环区分不同的物体,在这种情况下是螺栓和坚果,然后区分银色物体和黄色物体。为了进行颜色检测,图像被转换为hsv色空间。hsv代表色调、饱和度和值。分别。色调表示颜色的阴影;饱和度描述颜色的强度;和值(或亮度)描述颜色的暗度,通常称为亮度。这些参数的表示如图9所示。HSV将图像强度与颜色信息分开。当使用颜色基准方法时,hsv允许检测物体误差更小。这种颜色检测方法的结果可以是见图9[4]。

图9 HSV颜色空间表示

结合这些图像处理操作后,两个可以获得一组图像:一组具有无论是螺栓、螺母还是其他物体,其他一组图像是具有颜色数据的物体的图像。所有这些信息都是合并以成功分离所有物体[5]。结果如下图10所示。

图10 颜色检测后的图像(a)银色物体;(b)黄色物体

四、机器人武器控制

发送通过图像处理获得的所有信息通过串行端口发送到Arduino。更具体地说,发送物体信息(质心坐标,物体的方向和物体类型),这将被Arduino接收并用于控制机器人。

每个关节的角度是通过反向运动学来估计的,其中给出的信息是物体的质心,这是转换为机器人关节角度。提供接缝角度,机械臂能够成功地到达和拾取目标物体。在我们系统中,Arduino接收质心并处理所有运动学操作。在拿起一个物体后,坐标适当的盒子被送到机械臂上。然后是机械臂将物体放入框中。最后,机械臂将回到初始姿势。检测和分类过程是重复执行,直到在机械臂的伸出距离[6]。

机器人手臂接收来自Arduino的控制输入。Arduino负责直接控制的命令逆运动学的马达和算法[7]。逆运动学算法是基于关节的角度当机器人手臂到达特定的3D位置。使用Denavit Hartenberg[8]矩阵解决这一任务是可能的,而且在使用机械臂的运动学(见图11)。

图11 简化机械臂[6][9][10]

这是获得由D-H参数方程计算的参数显示在下面的使用

表一:DENAVIT-HARTENBERG 参数表

|

I |

a |

A |

d |

|

|

1 |

90 |

0 |

L1 |

|

|

2 |

0 |

Lh |

0 |

|

|

3 |

0 |

L3 |

0 |

|

|

4 |

0 |

L4 |

0 |

(2)

(3)

(4)

(5)

使用T1–T4,可以找到以下三个物理笛卡尔坐标(x,y,z)到计算机械臂将到达的位置

(6)

(7)

(8)

为了捕捉任何给定方向的物体(见图12)。由软件提供基于手腕输出值的手腕旋转角度

,根据几何分析,建立了以下方程。

(9)

图12 臂爪计算角度

在计算机之间设置串行通信,执行图像处理算法和控制机械臂。图像处理部分发送机器人的坐标、方向和物体类型将此信息转换为联合的控制器用于拾取所需物体并将其放置到合适的篮子。

五、软件实施

为了实时进行图像处理,算法需要在主机上实现。OpenCV是一个包括大量计算机视觉的图书馆,图像处理与通用数值算法大量的计算机视觉问题。大部分在opencv中实现的算法在与matlab比较。OpenCV也有C/C 、Python、Java以及其他最流行的编程接口语言。为了与ARDUIO接口,C 用于接口具有图像处理和串行通信功能。鉴于自然,C 是一种通用的高级编程广泛用于处理计算机视觉的语言问题。臂的控制输入由反向生成在Arduino控制器上实现了运动学算法。

Arduino是一款开源单板微控制器包括包含标准编程的软件语言编译器。IDE和引导加载程序加载编译的通过USB端口通过串行端口进入芯片。用PCA9685板,Arduino控制器可作为

控制臂上所有伺服电机的仪器同时。收到Arduino控制器的控制输入后,PWM(脉宽调制)信号将由arbotix-m微控制器。这些信号将用于控制每个电机。伺服电机提供精确定位

卡在特定角度上的任何接头。伺服电机不要连续旋转,它们的旋转限制在固定角度通常它们可以从0旋转到180度,但其中一些达到了360度。伺服电机通常有三个输入端: 5伏电源,接地和脉宽调制。通过改变脉宽调制信号伺服电机和因此,手臂可以执行不同的动作进行分类物体。

六、结果分析

机器人取货和运送的一些结果流程见图13和14。我们可以看到每物体被正确地拾起和运送。系统可以区分不需要的物体并将其从然后将螺栓和螺母正确分离并放置放在相应的箱子里。最后,系统还可以区分不同颜色的重叠螺栓,并分开通过移动或推动它们,以便在下一个迭代。今后,我们将把整个系统从PC移植到PI上。

图13 拿起一个银螺栓,把它送到正确的盒子里

图14 拿起一个银螺帽,把它送到正确的盒子里

该系统的性能可以用一系列的影响因素,如照明的环境,思考在物体的表面。在一个系统参数的调整,该系统可以适应不同的环境中去。通过迭代过程可以在交付的所有物体,不管他们的位置,颜色和方向。

七、结论

通过结合图像处理算法,运动学算法,我们开发了一个机器人手臂,可以分拣物体根据其形状和颜色。对于未来的工作,图像处理将基于ARM并在树莓派上实现。对树莓派执行图像处理在提高效率的同时减小系统的尺寸在功耗。再通过安装光传感器CAN减少来自环境的干扰,使用更多复杂的神经网络可以帮助系统区分更大种类的物体。

参考文献

[1] N. Rai, B. Rai and P. Rai, 'Computer vision approach for controlling educational robotic arm based on object properties,' in Emerging Technology Trends in Electronics, Communication and Networking (ET2ECN), 2014 2nd International Conference on, 2014.

[2] R. Mussabayev, 'Colour-based object detection, inverse kinematics algorithms and pinhole camera model for controlling robotic arm movement system,' in Electronics Computer and Computation (ICECCO), 2015 Twelve International Conference on, 2015.

[3] P. S. Lengare and M. E. Rane, 'Human hand tracking using MATLAB to control Arduino based robotic arm,' in Pervasive Computing (ICPC), 2015 International Conference on, 2015.

[4] S. D. Gajbhiye and P. P. Gundewar, 'A real-time color-based object tracking and occlusion handling using ARM cortex-A7,' in India Conference (INDICON), 2015 Annual IEEE, 2015.

[5] Q. Ji and W. Qi, 'A color management system for textile based on HSV model and bayesian classifier,' in Control, Automation, Robotics and Vision, 2008. ICARCV 2008. 10th International Conference on, 2008.

[6] R. Szaboacute; and A. Gontean, 'Controlling a robotic arm in the 3D space with stereo vision,' in Telecommunications Forum (TELFOR), 2013 21st, 2013.lt;

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[18804],资料为PDF文档或Word文档,PDF文档可免费转换为Word